description 概要

IMAGINEは、自動運転車内のエンタメにおける「未来の空白」を埋めるアプリです。車窓から注視した建物をAIが検出し、音声でツアーガイドとして情報を届けることを目的としています。

これまで衝突回避などの安全のために用いられてきた自動運転の画像認識技術を、乗員の移動体験向上のために活用します。

groups チーム編成

私

フロントエンド・バックエンド実装、Geminiのプロンプト設計、リレーサーバ実装を担当。

コータ様

アイデア出し、AAOS関係、初期のアプリデザイン、フロントエンド部分を担当。

build 使用した技術

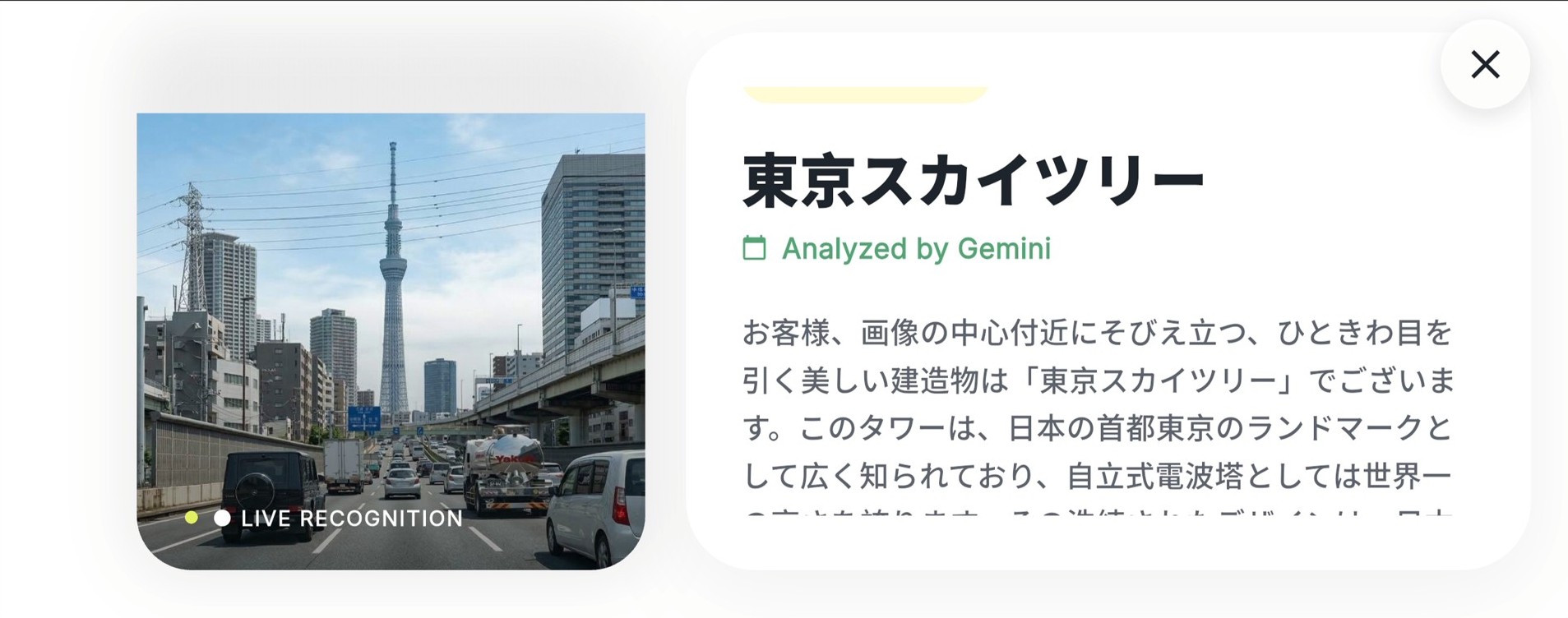

Geminiと読み上げ機能を用いた解説システム

視線先の建物画像をGeminiに入力し、解説文と対象物の情報を取得する。

さらにTTSで読み上げることで、バスガイドのような体験を実現しました。

さらにTTSで読み上げることで、バスガイドのような体験を実現しました。

MediaPipeでの顔認識

車載器などのモバイル端末で、処理負荷を軽減するためにMediaPipeと接続方法にMethodChannelを使いました。

また、全ての顔が検出開始から2秒間静止している場合に検出するようにし、運転手がうとうとしているなどの場合に

誤動作しないようにしました。

また、全ての顔が検出開始から2秒間静止している場合に検出するようにし、運転手がうとうとしているなどの場合に

誤動作しないようにしました。

未来の車(AAOS) にカメラが無い制約を、スマホ+リレーサーバで解決

AAOSには原則カメラが無いため、スマホからGoogle Cloud Computing Engine上に構築したリレーサーバに接続してカメラ映像や切り替えコマンドを送信できるようにしました。